您可能听说过也可能没有听说过提示工程。从本质上讲,它是“有效地与人工智能沟通以获得你想要的东西”。

大多数人都不擅长即时工程

然而,它正在成为一项越来越重要的技能……

因为垃圾输入 = 垃圾输出。

这是您需要提示的最重要的技巧👇

我将语言模型称为“LM”。

语言模型的例子有@OpenAI的 ChatGPT 和@AnthropicAI的 Claude。

1. 角色/角色提示

为 AI 分配角色。

例子:“你是 X 方面的专家。你帮助人们做 Y 已经 20 年了。你的任务是给出关于 X 的最佳建议。

如果理解,请回复“知道了”。

一个强大的附加组件如下:

“你必须在回答之前先问问题,这样你才能更好地理解提问者的意图。”

稍后我将讨论为什么这如此重要。

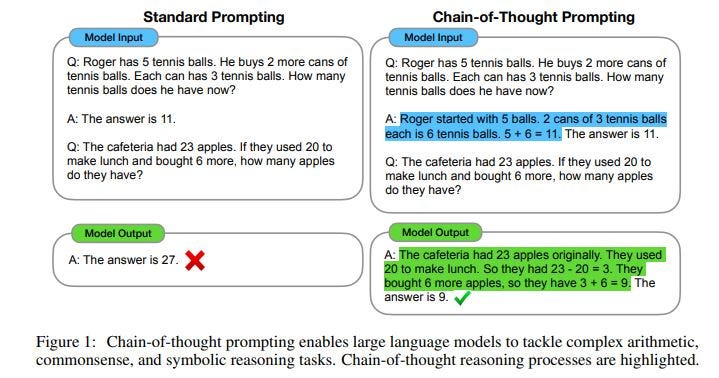

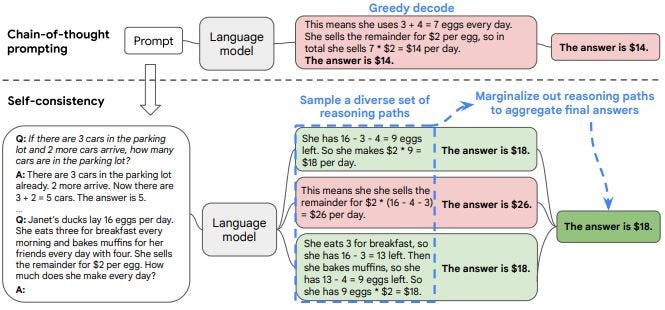

2.COT

CoT 代表“思想链”

它用于指示 LM 解释其推理。

例子:

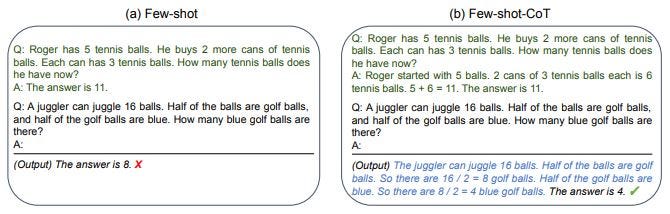

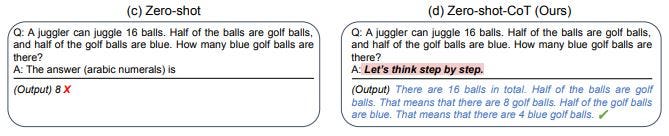

3. 零射击 CoT

零样本是指模型在提示中没有额外训练的情况下做出预测。

我会在一分钟内进行几次射击。

注意通常 CoT > Zero-shot-CoT

例子:

4. Few-shot(和 few-shot-CoT)

Few-shot 是指 LM 在提示中给出了几个示例,以便它更快地适应新示例。

例子:

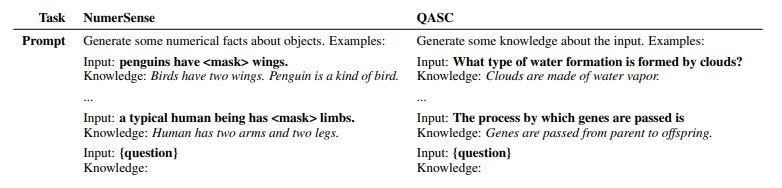

5. 知识生成

通过提示 LM 生成与问题相关的知识。

这可用于生成的知识提示(请参阅进一步信息)。

例子:

6. 生成的知识

现在我们有了知识,我们可以将该信息输入新提示并提出与知识相关的问题。

这样的问题称为“知识增强”问题。

7. 自洽

该技术用于生成多个推理路径(思维链)。

多数答案作为最终答案。

例子:

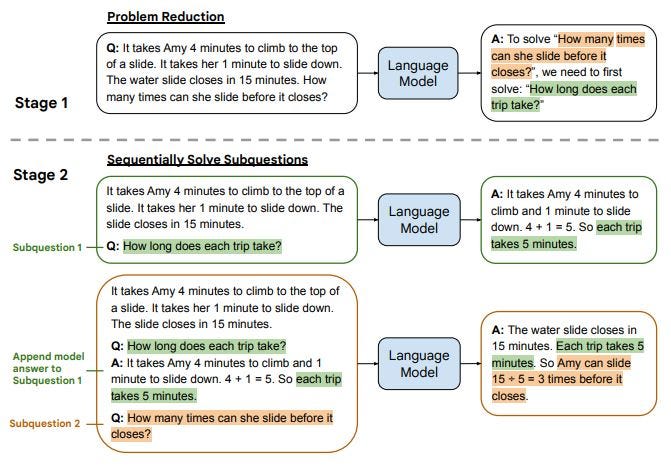

8. 长期管理

LtM 代表“从最少到最多”

该技术是 CoT 的后续技术。此外,它的工作原理是将问题分解为子问题,然后解决这些问题。

例子:

参考书目:

参考 1:

Wei, J.、Wang, X.、Schuurmans, D.、Bosma, M.、Ichter, B.、Xia, F.、Chi, E.、Le, Q. 和 Zhou, D. (2022)。思维链提示在大型语言模型中引发推理。

参考 2:

Kojima, T.、Gu, SS、Reid, M.、Matsuo, Y. 和 Iwasawa, Y. (2022)。大型语言模型是零样本推理机。

参考 3:

Liu, J.、Liu, A.、Lu, X.、Welleck, S.、West, P.、Bras, RL、Choi, Y. 和 Hajishirzi, H. (2021)。常识推理的生成知识提示。

参考 4:

Wang, X., Wei, J., Schuurmans, D., Le, Q., Chi, E., Narang, S., Chowdhery, A., & Zhou, D. (2022)。自洽性改进了语言模型中的思维链推理。

参考 5:

Zhou, D., Schärli, N., Hou, L., Wei, J., Scales, N., Wang, X., Schuurmans, D., Cui, C., Bousquet, O., Le, Q., & Chi, E. (2022)。Least-to-Most 提示支持大型语言模型中的复杂推理。

您想进一步了解哪些技术?在评论中让我知道。

数据统计

数据评估

本站六耳AI工具中文导航站提供的ChatGPT:您需要学习的 8 种提示技巧(没有废话!)都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由六耳AI工具中文导航站实际控制,在2023年 3月 27日 下午11:11收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,六耳AI工具中文导航站不承担任何责任。

相关导航

Deepora AI

豆包

openapi官方github

Share & Find Top Rated ChatGPT Prompts

Human or Not

فضفض

chatgpt