延续便宜大碗特点的基础之上,DeepSeek V3发布即完全开源,直接用了53页论文把训练细节和盘托出的那种。

怎么说呢,QLoRA一作的一个词评价就是:优雅。

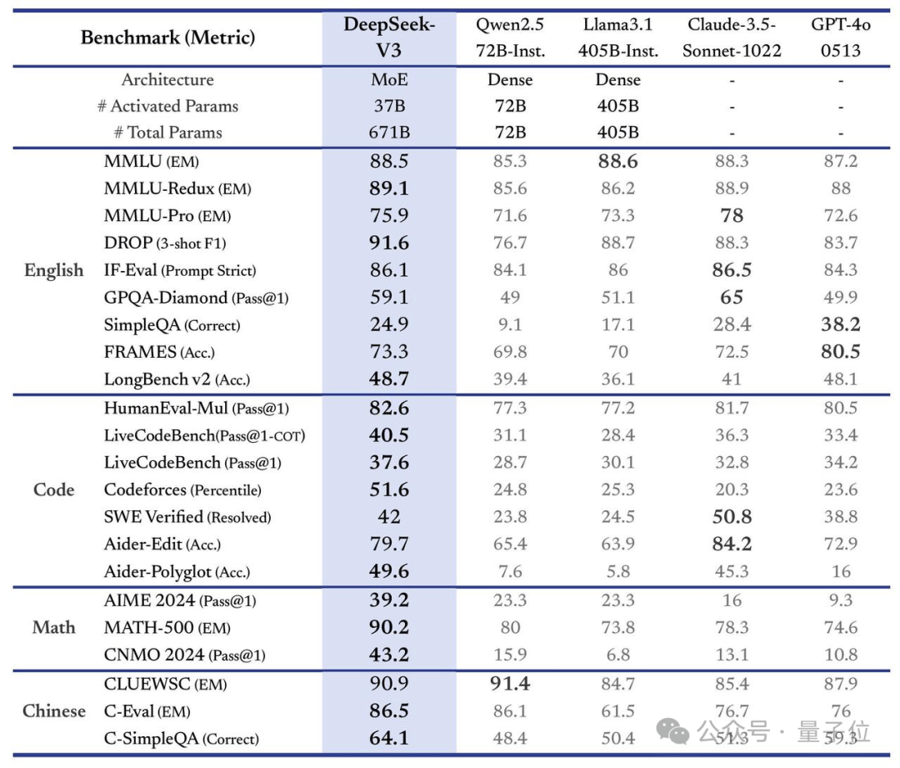

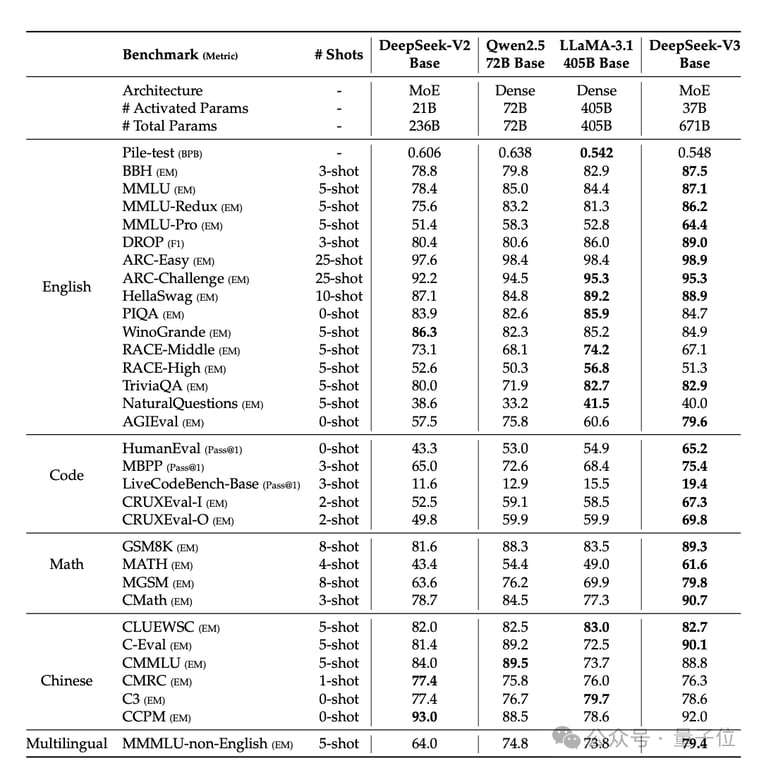

具体来说,DeepSeek V3是一个参数量为671B的MoE模型,激活37B,在14.8T高质量token上进行了预训练。

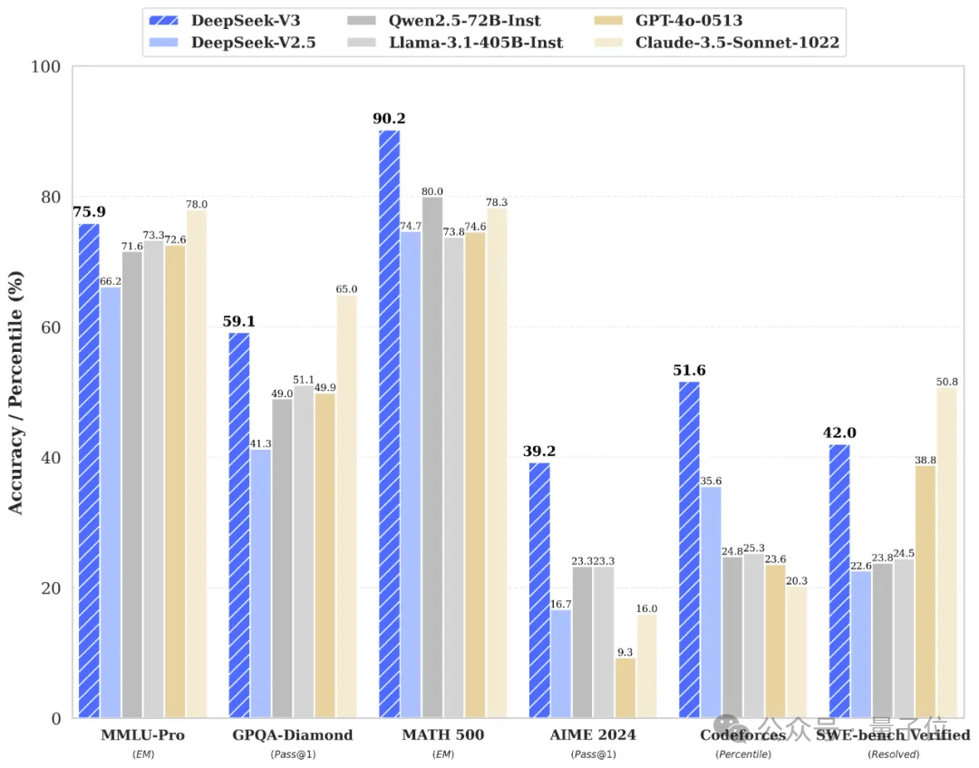

在多项测评上,DeepSeek V3达到了开源SOTA,超越Llama 3.1 405B,能和GPT-4o、Claude 3.5 Sonnet等TOP模型正面掰掰手腕——

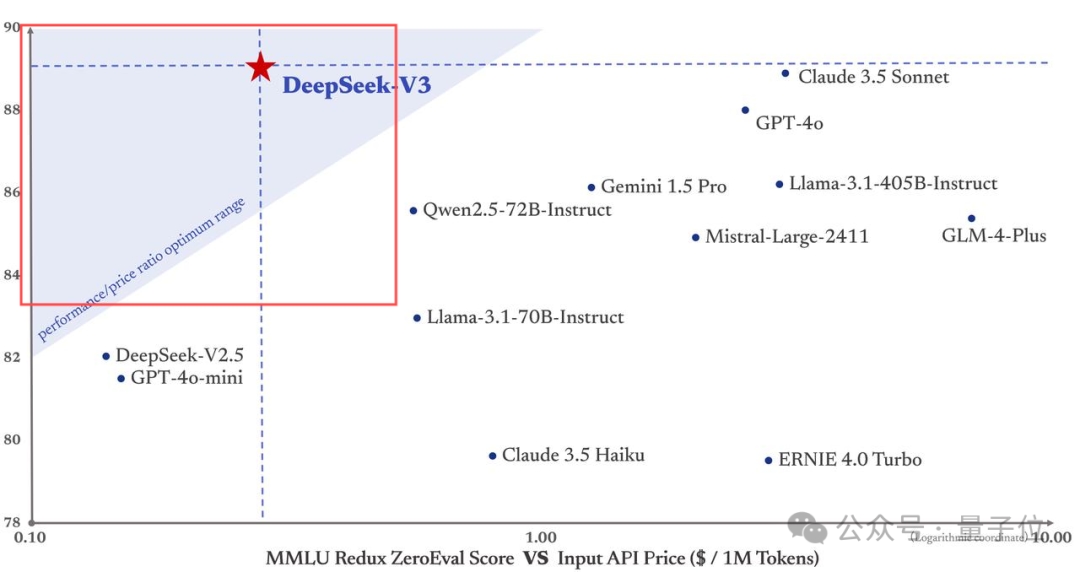

而其价格比Claude 3.5 Haiku还便宜,仅为Claude 3.5 Sonnet的9%。

我们整理了外网上对于DeepSeek V3的热议,综合了「量子位」和「新智元」的内容。

01

只用了550万美元,

大概是7b Llama2 的成本

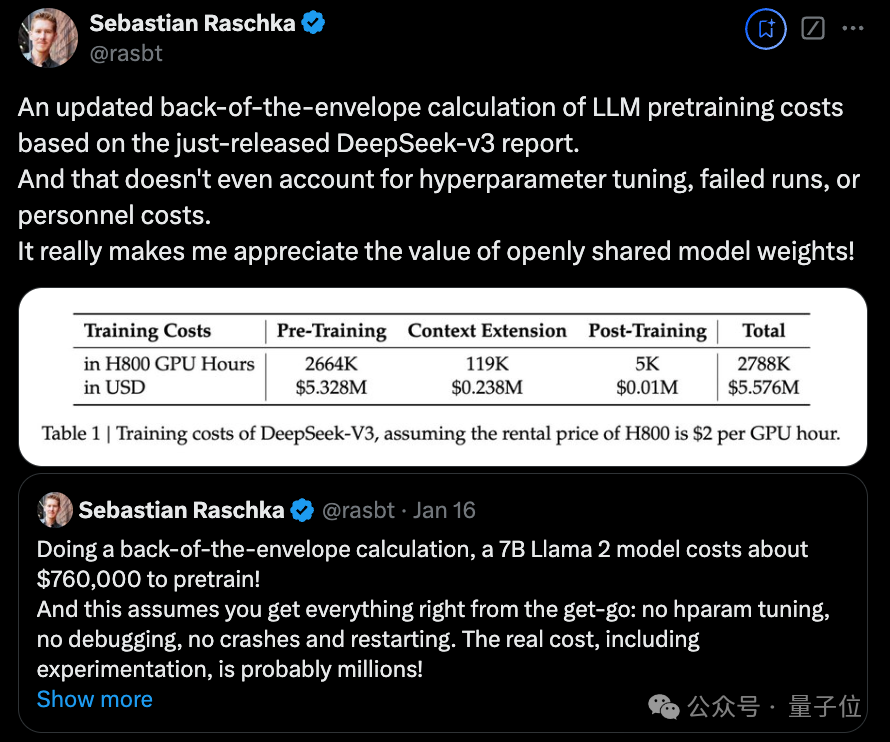

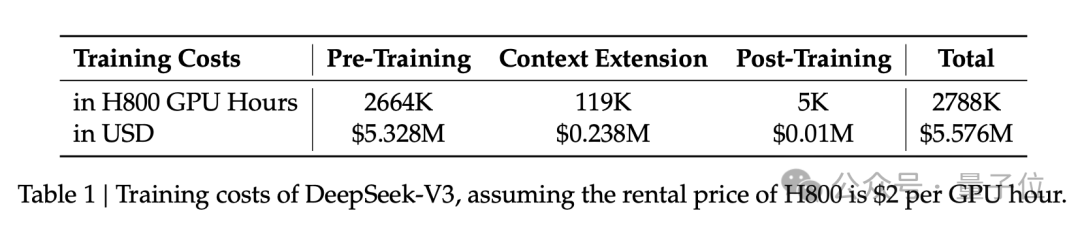

DeepSeek V3整个训练过程仅用了不到280万个GPU小时,相比之下,Llama 3 405B的训练时长是3080万GPU小时(p.s. GPU型号也不同)。

直观地从钱上来对比就是,训练671B的DeepSeek V3的成本是557.6万美元(约合4070万人民币),而只是训练一个7B的Llama 2,就要花费76万美元(约合555万人民币)。

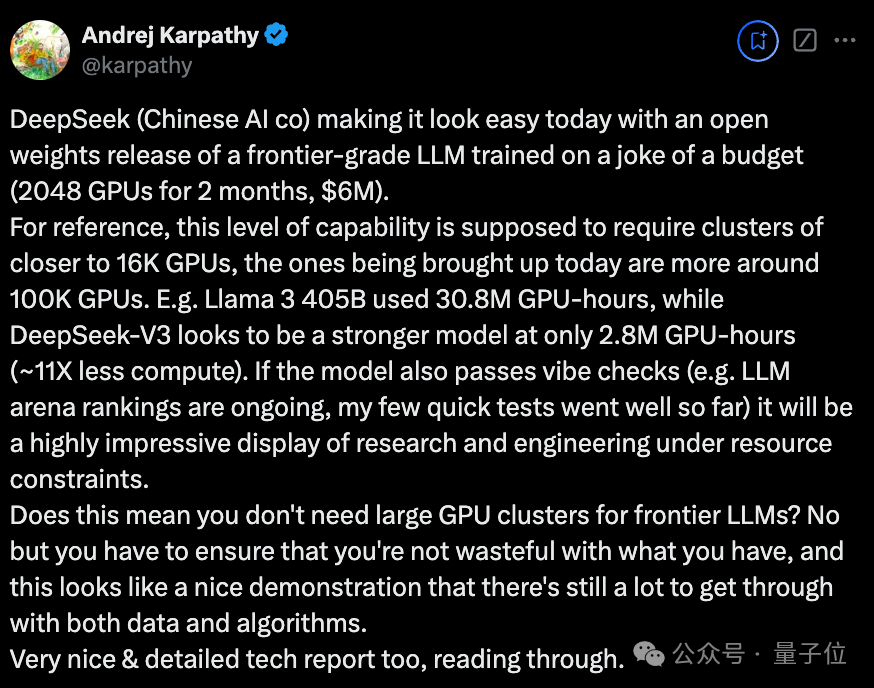

OpenAI创始成员Karpathy对此赞道:

作为参考,要达到这种级别的能力,通常需要约1.6万个GPU的计算集群。不仅如此,当前业界正在部署的集群规模甚至已经达到了10万个GPU。

比如,Llama 3 405B消耗了3080万GPU小时,而看起来更强大的DeepSeek-V3却只用了280万GPU小时(计算量减少了约11倍)。到目前为止,模型在实际应用中的表现相当出色——不仅在LLM竞技场名列前茅,而且从Karpathy本人的快速测试来看,结果也都很不错。这说明,即便是在资源受限情况下,模型也能展现出令人印象深刻的研究和工程能力。

这是否意味着前沿LLM不需要大型GPU集群?不是的,但这表明,你必须确保不浪费已有的资源,这个案例很好地证明了在数据和算法方面还有很大的优化空间」。

Meta科学家田渊栋也惊叹DeepSeek V3的训练看上去是“黑科技”:

这是非常伟大的工作。

02

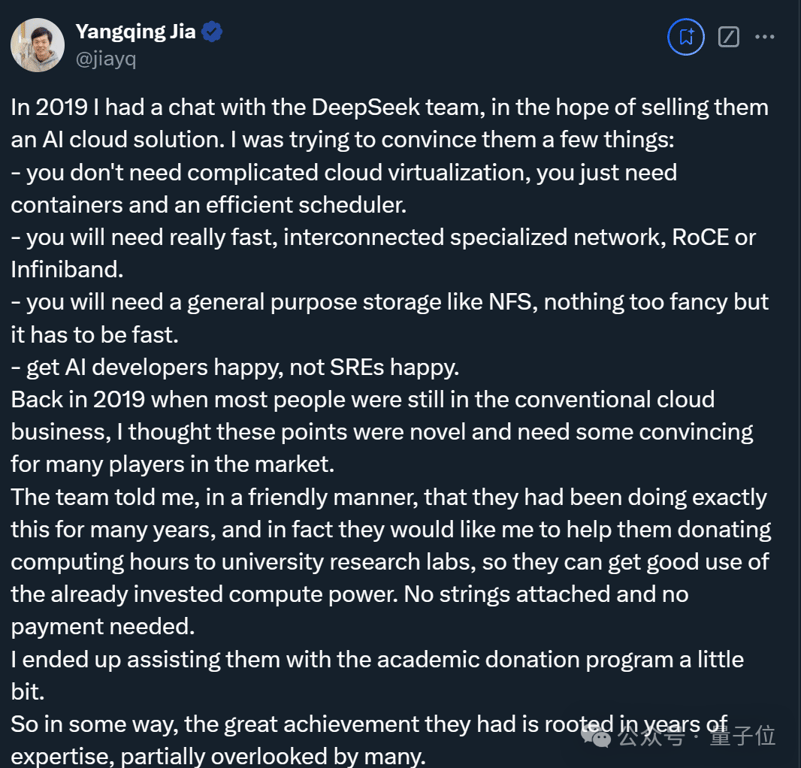

贾扬清力赞,

各路评测碾压

贾扬清针对推理提出了几点自己的思考:

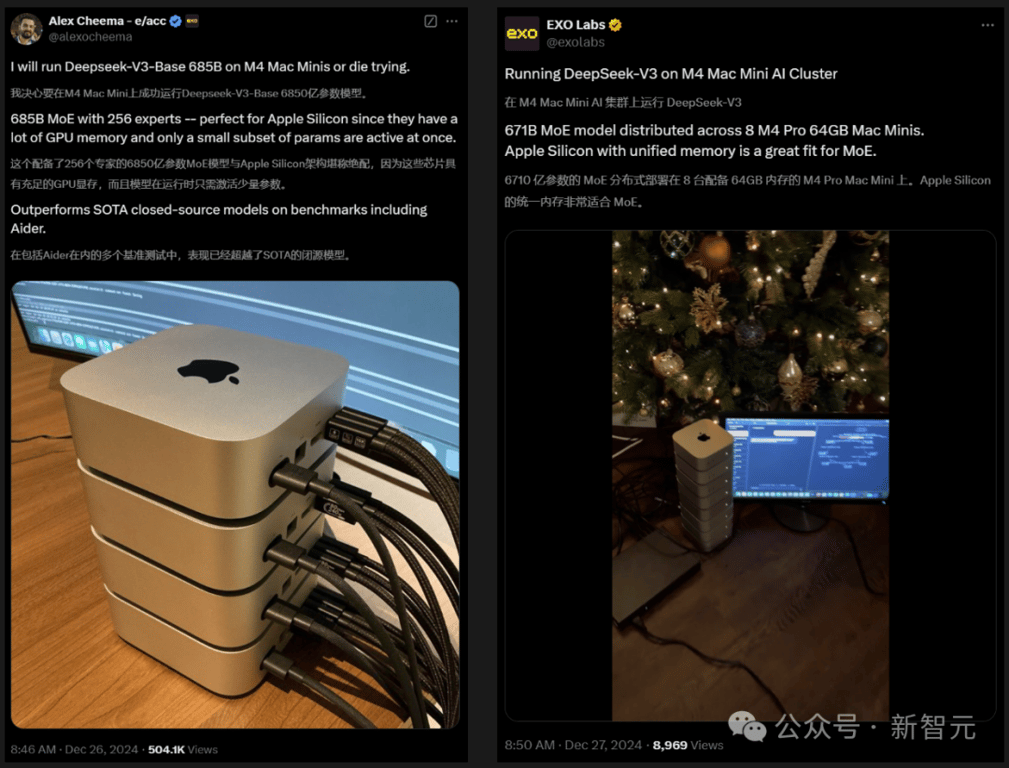

- 首先最重要的是,我们正式进入了分布式推理时代。一台单GPU机器(80×8=640G)的显存已经无法容纳所有参数。虽然更新大显存机器确实可以装下模型,但不论如何,都需要分布式推理来保证性能和未来扩展。

- 即使在单个模型中,也需要关注MoE的负载均衡,因为每次推理只有大约5%的参数激活。

- 论文中特别提到引入「redundantexpert」概念,正是为了解决这个问题。这已经不再是「一个模型多个副本」的问题、而是「每个模型子模块都有多个副本」,然后独立扩缩容。

-

输入token很容易实现盈利。根据个人专业判断,需要大量优化才能使输出token盈利或实现收支平衡。但如果我们相信「软件摩尔定律」,这就不

从模型能力来看,其评测跑分不仅超越了Qwen2.5-72B和Llama-3.1-405B等开源模型,甚至还和一些顶尖闭源模型(如GPT-4o以及Claude-3.5-Sonnet)不分伯仲。

从实际响应来看,其生成速度提升了3倍,每秒生成60个tokens。

在又快又好的同时,DeepSeek V3的API价格也被打下来了。

每百万输入tokens 0.5元(缓存命中)/ 2元(缓存未命中),每百万输出tokens 8元

单论价格,正如一开始提到的,它几乎是Claude 3.5 Sonnet的1/53(后者每百万输入3美元、输出15美元)。

而如果要平衡性能和成本,它成了DeepSeek官方绘图中唯一闯进“最佳性价比”三角区的模型。

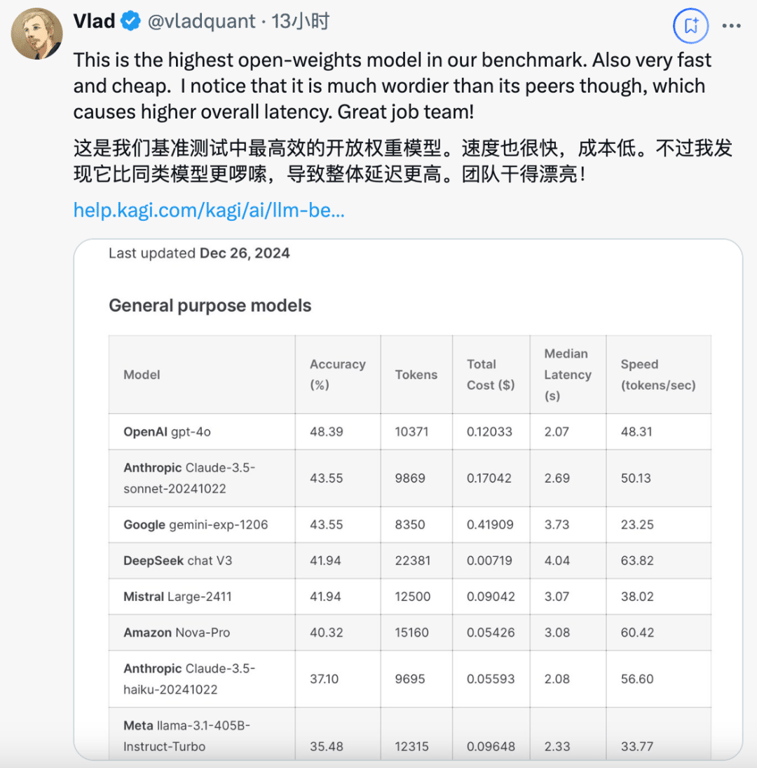

在搜索产品Kagi的评测中,V3 也是站在了开源之首,紧追Sonnet-3.5 与GPT-4o。

03

网友评测整活

04

预训练细节

我们继续掰开论文细节。先来看最受关注的预训练部分:

官方介绍,通过在算法、框架和硬件方面的协同优化,DeepSeek V3的训练成本变得非常经济。

预训练阶段,在每万亿token上训练DeepSeek V3仅需要18万GPU小时,就是说,在官方2048卡集群上,3.7天就能完成这一训练过程。

研发团队用了不到2个月的时间就完成了DeepSeek V3的预训练,耗费了266.4万GPU小时,再加上上下文长度扩展的11.9万GPU小时,和后训练的5000 GPU小时,总训练成本为278.8万GPU小时。

假设GPU租赁价格为每GPU小时2美元,那成本换算过来就是557.6万美元。

所以,具体是什么样的协同优化?

官方标注了几个重点:

首先,架构方面,DeepSeek V3采用了创新的负载均衡策略和训练目标。

研发团队在DeepSeek-V2架构的基础上,提出了一种无辅助损失的负载均衡策略,能最大限度减少负载均衡而导致的性能下降。

具体而言,该策略为MoE中的每个专家引入了一个偏置项(bias term),并将其添加到相应的亲和度分数中,以确定top-K路由。

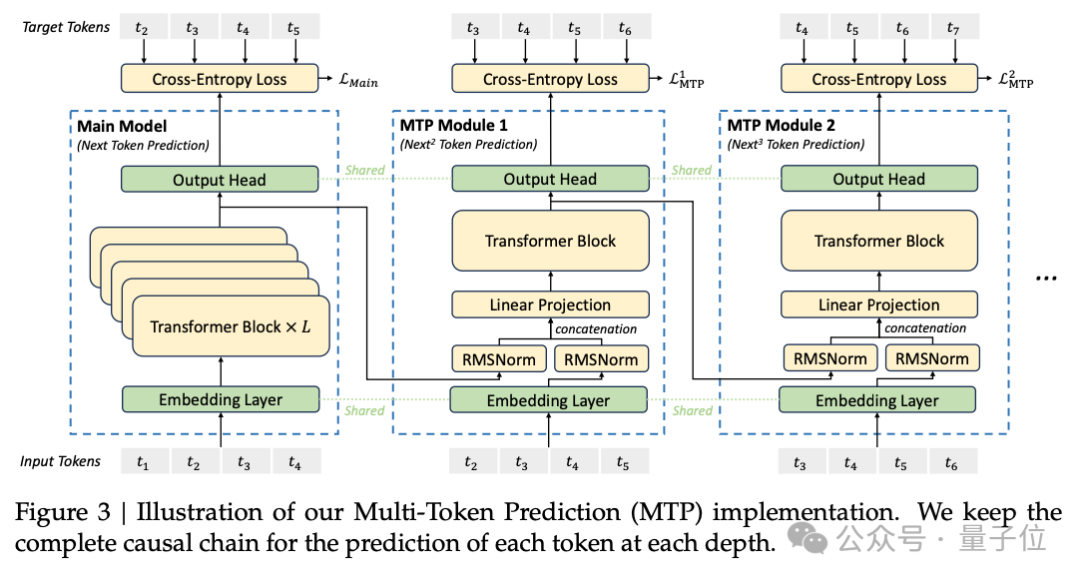

研发团队还证明,多Token预测目标(Multi-Token Prediction,MTP)有利于提高模型性能,可以用于推理加速的推测解码。

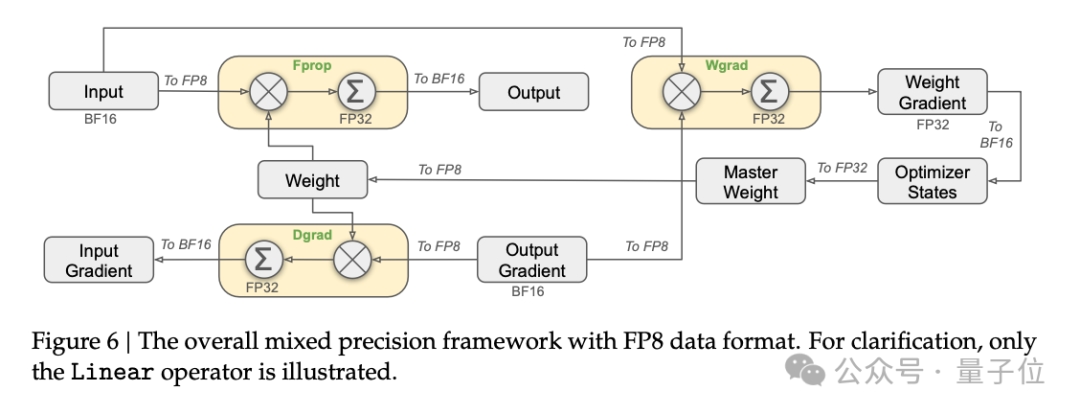

预训练方面,DeepSeek V3采用FP8训练。研发团队设计了一个FP8混合精度训练框架,首次验证了FP8训练在极大规模模型上的可行性和有效性。

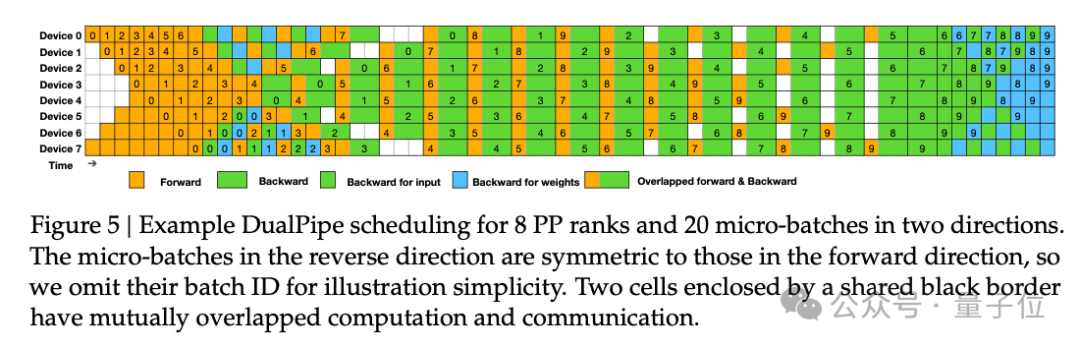

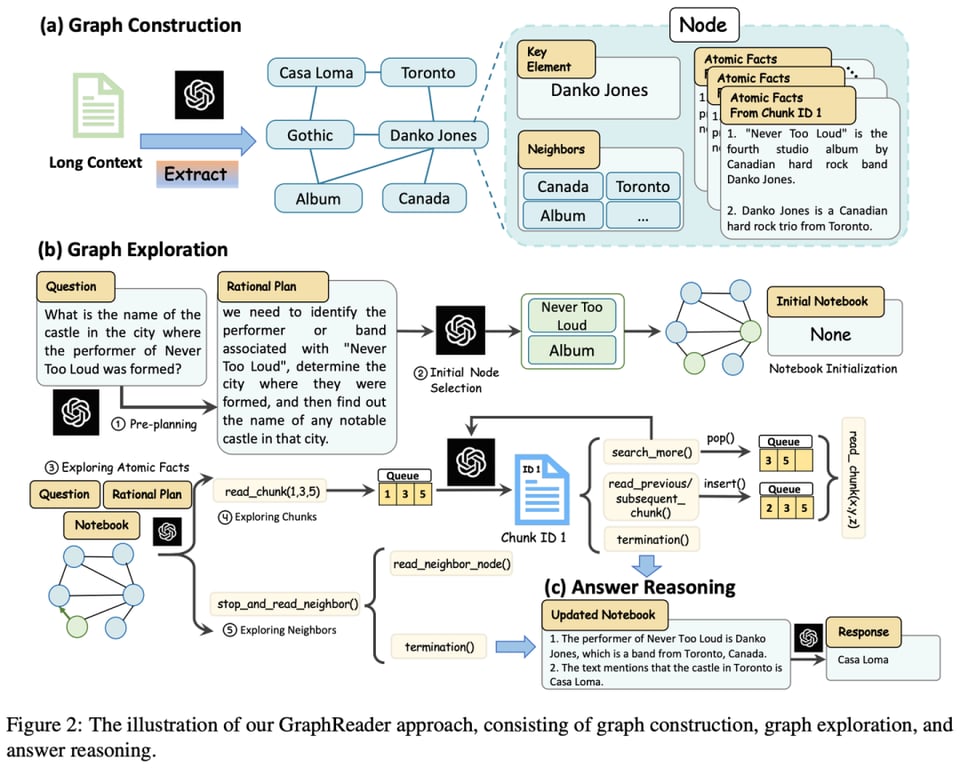

论文中还提到了跨节点MoE训练中的通信瓶颈问题。解决策略包括,设计DualPipe高效流水线并行算法:在单个前向和后向块对内,重叠计算和通信。

这种重叠能确保随着模型的进一步扩大,只要保持恒定的计算和通信比率,就仍然可以跨节点使用细粒度专家,实现接近于0的all-to-all通信开销。

另外,研发团队还开发了高效的跨节点all-to-all通信内核等。

后训练方面,DeepSeek V3引入了一种创新方法,将推理能力从长思维链模型(DeepSeek R1)中,蒸馏到标准模型上。这在显著提高推理性能的同时,保持了DeepSeek V3的输出风格和长度控制。

其他值得关注的细节还包括,DeepSeek V3的MoE由256个路由专家和1个共享专家组成。在256个路由专家中,每个token会激活8个专家,并确保每个token最多被发送到4个节点。

DeepSeek V3还引入了冗余专家(redundant experts)的部署策略,即复制高负载专家并冗余部署。这主要是为了在推理阶段,实现MoE不同专家之间的负载均衡。

最后,来看部分实验结果。

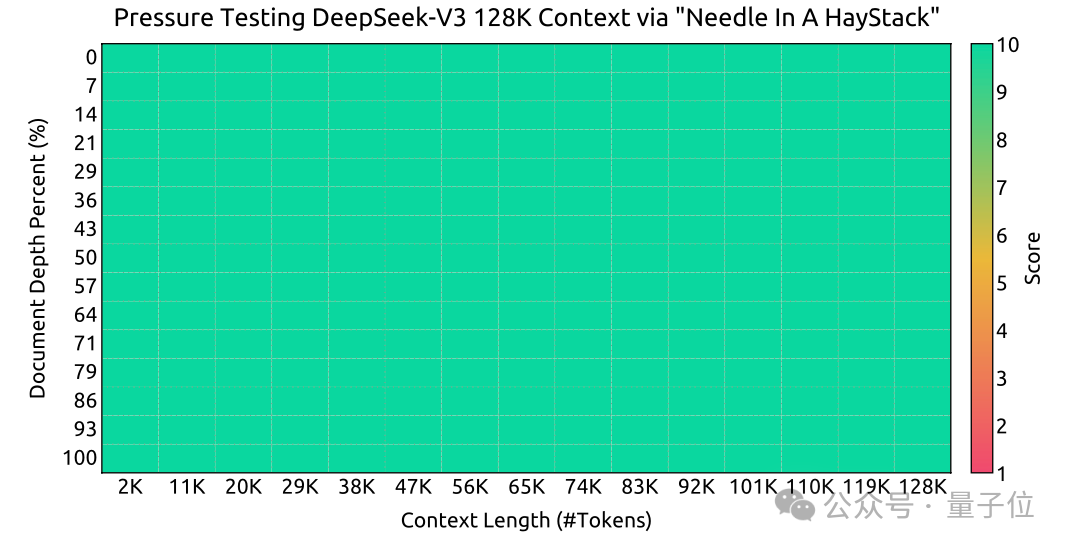

大海捞针实验:

可以看到,在各项基准测试中,DeepSeek V3在开源模型中达到SOTA。

体验地址:chat.deepseek.com

技术报告地址:

https://github.com/deepseek-ai/DeepSeek-V3/blob/main/DeepSeek_V3.pdf

抱抱脸开源地址:

https://huggingface.co/deepseek-ai/DeepSeek-V3

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

![[推荐]如何用 AI 写出比人更好的文字](https://ainavtool.com/wp-content/uploads/2024/12/640.jpeg)