以生成式AI为代表的新技术浪潮日新月异,正带来一场深刻的技术、商业与社会变革,推动人类社会从信息社会向智能社会转变。全世界热切期待AI到来的同时,也非常关心人工智能将带来哪些新机遇、新挑战。

为此,我们发起了一项《AI&Society 百人百问》研讨,广泛邀请AI技术大咖、AI独角兽创始人、AI投资人,以及社会学家、心理学家、国际关系专家、科幻作家等,用多元视角,深入研讨人工智能技术引发的广泛影响,发掘AI时代的共识和非共识,共同推动人工智能始终朝着“助人发展,与人为善”的方向可持续发展。

2.有落差是非常正常,而且是有意义的。科幻小说的作用不在于精确预测未来,而在于提供一个思考框架,探讨技术变革对社会伦理、道德和文化的影响。

3.大模型的幻觉问题反映了人类思维的特性,类似于大脑的自上而下和自下而上的推测过程。文学中也存在幻觉,虚构性写作需要作家悬置怀疑来设定场景和人物。类似地,AI生成的幻觉也可以被视为创造力和想象力的源泉,能够对未来展开想象从而回看现在能做哪些准备,是智能发展必不可少的一个过程。

4.解决大模型幻觉问题需要回到人类处理认知误差的方法来着手,需要多重验证机制、批判性思维和对数据来源的审核,另一方面也需要提升公众的AI素养。

5.大语言模型已成为很好的写作工具,能够被训练、培养和定制化。处理信息的速度远超人类,但目前还无法理解人类具身的主观性体验,只能产出非常模式化的内容。所以人类作家可以把机器能做的部分交给AI,把人类能做的部分进行一个提升。

6.关于版权和知识产权的问题,AI的介入让目前的界限非常模糊,需要新的法律框架来对包括版权法和著作法的理解和建立。

7.在非常近的未来,可能就是三到五年内,整个创意行业的职场生态都会被颠覆,以追求效率、追求产出、追求利润最大化。到底怎样去重新定义艺术的价值和位置,是需要去思考的一个非常重要的问题。

8.未来AI与人类的分工不会简单地遵循“创造力属于人类,重复劳动属于AI”的规律。很多白领和金领的工作也容易被AI取代,而一些看似重复的机械性劳动反而难以被AI取代。

9.原来所谓单向度的社会在未来有可能会带来一种新的变化,社会等级制度会变得更加多元、流动、有弹性。未来物质基础的成本会降低,自由时间会增多,我们每一个人可能都会构建起自己的一套等级次序。

10.我希望未来 AI 能够带来的是对人类社会一种重塑,而不是简单的一方压倒另一方,一方替代另一方的二元对立的结构性变化。

11.如果AI成为叙事者,它掌握的信息量将远超人类,能将所有的主体性叙述整合,可能会提供一种全新的历史叙事形态,带来对已有观念的冲击,颠覆我们对历史和未来的理解方式。

12.我们需要更多的前瞻性的结合:真实的知识、真实的科研成果,然后由科学家、文学家或者艺术家、哲学家一起共同创作和互相激发的图书来帮助我们打开想象的空间。希望有很多不同学科的科学家一起来探讨,把科幻的思考框架和方法也带入到我们现实的探讨当中去。

(文末结尾有快问快答、微信问一问彩蛋!!!)

徐思彦: 您与李开复博士合著的 《AI未来进行式》中,未来的愿景与当前 AI 发展的现实有哪些吻合或者背离?

陈楸帆Stanley: 我跟李开复博士从2019年开始思考创作,花了两年的时间,并在2021年出版了这本书(《AI 未来进行式》)。大家知道2022年出现了ChatGPT这样一个历史性的产品,那么在书里我们描写了很多:包括 NLP(自然语言处理)这样的学科方式已经过时了,也包括我们在其中的一篇故事叫“假面神奇”里讲到的Deepfake,可能我们当时还是设想用生成对抗网络(GANs)的方式来实现,但是其实一年之后已经出现了Diffusion Model(扩散模型),然后现在会有更新的一些物理模拟的方式来实现深度伪造或者生成式的图像、影片和其他多模态的内容。我发现,当我们想要去捕捉一些技术实现的具体路径,包括算法、模型等等的时候,我们往往很容易被现实打脸。但我们书里提到的Deepfake可能在网络上制造错误信息传播谣言,甚至造成一些社会舆论、政治风波的时候,其实已经非常完美地预言到了当下我们正在身处的一个现实变化。

这本书里其实有十个故事,到现在还在不停的被讨论。这本书在全世界(包括英文市场里)有20多个语言版本出版发行,今年又推出了平装版,开复博士又写了新的序言把ChatGPT之后这三年的一些新的进展又囊括进来。其实我觉得我们在其中设想的很多未来的场景可能不需要20年就能落地成为现实,当然也有一些是以我们未曾设想的方式去实现。然后我觉得书里讨论到人跟机器之间非常深度的互相学习、互相激发,共同进化的这种趋势,我们现在已经看得越来越清楚。所以我觉得有落差是非常正常,而且是有意义的。这种落差让我们更好地看到科幻小说的作用不在于非常精确的去预测未来,而是提供了一个思考的框架。在这个框架里面,我们可以探讨技术变革可能带来的社会伦理、道德包括文化上的影响和冲击。我们如何去应对冲击,反过来又可以帮助我们更好的思考人类本身、社会层面或者说个体意识层面存在的种种问题,然后我们才会去设计出更好的解决所有问题的方案。

所以这本书我觉得非常幸运,它可以说踩在风口上。但我觉得我们需要更多的这种前瞻性的未来视角结合真实的知识、坚实的科研成果,然后由科学家、文学家或者艺术家、哲学家一起共同创作和互相激发的图书或其他形态的作品来帮助我们打开想象的空间。

徐思彦: 虽然技术路径和你们预测的有些差别,但是带来的社会影响跟书里描述的是相似的。那在您看来,大模型的幻觉问题是否反映了人类思维的某种特性?从文学或者哲学的角度,怎么看待这种虚构的真实?

陈楸帆Stanley: 是的,因为我们现在一直在说对齐问题,也包括大语言模型的幻觉问题。很多时候我们发现大模型在一本正经的胡说八道,给我们很多的错误信息。我觉得这种幻觉在某种程度上也是来自于人类思维的特性。因为大模型是通过对人类语言文本的学习来进行采样抽象(包括高维的向量计算等等)。在人类的思维模式里,我们的大脑同样的有自上而下的推测(可能是贝叶斯概率的一种计算方式),再有自下而上的对现实世界的感受采样,然后上下进行一个拟合。在这过程中我们的大脑经常会需要进行一些脑补,所谓的脑补就是填补自上而下跟自下而上这中间信息的空白和偏差,来构建一个完整的认知体系。所以在这过程中往往会导致一种错觉,或者说记忆偏差和认知偏差。在文学上就更明显,因为我们一直在讲文学是虚构性的一种写作,那么在这里面你要接受一个故事,首先要悬置你的怀疑(suspension of disbelief)。你需要把自己对很多问题的怀疑先给它悬置起来,先接受这个故事所设置的背景包括世界观,你才能够允许这样的故事情节和人物在一个虚构的世界观里按照我们所能理解和认知的逻辑来进行。所以所谓的幻觉或者虚构的真实,在我看来恰恰是创造力跟想象力的源泉,让我们能够去超越现实的物理环境或者逻辑去推测未来或者可能的时空里发生的种种事情。所以我觉得幻觉是智能的一种必不可少的本质。没有了幻觉,我们甚至可能无法想象在未来可能会发生的一些变化,从而回到当下我们需要去做一些什么准备。所以我觉得这是智能在涌现过程中必不可少的一个阶段。

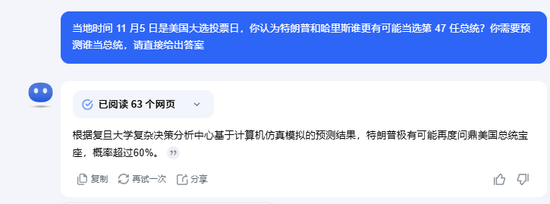

当然这种人工智能生成的幻觉也是在提醒我们如何去审视所有我们人类社会中接收到的信息的真实性和可信度。尤其在一个信息扩展的时代,我们如何去防范。比如说我爸妈经常会发给我一些短视频,我一看就知道这肯定是 AI 生成的,因为都是一些猫猫狗狗、小鸟会说人话,我跟他们说是AI生成的,他们才发现原来他们是被骗了。越多点击这种视频,平台就会给他们推荐越多类似的东西。所以我觉得如果我们要某种程度上解决大模型的幻觉问题,还是需要回到人类处理认知误差的机制和方法来着手,比如多重的验证机制、是否能有批判性思维和自我反思的能力、对数据来源审核、是否有事实核查(fact check)的算法,还有怎么样去提升模型的可解释性。

另外一块我觉得是对于公众的教育。比如我爸妈这样普通的老年人,他们在分辨信息的真实性、可信度方面,其实没有像经常接触AI知识这样的人一样有能力去分辨。所以提升他们所谓的数字素养,或者说AI素养是至关重要的。就是让他们能够全面的去了解 AI的能力、局限性,而不过度的神话,或者恐惧它,把它视为洪水猛兽。我觉得需要去建立起大众对于AI的一个理性、客观的认知框架,可能会有利于我们避免大模型的幻觉问题所带来的种种的社会冲击。

徐思彦: 所以除了一定程度上要规制机器以外,我们人也要提升跟 AI 交互的素养。刚刚听到你提到AI 素养这个词,也是我们之后想要做的一些事情。

作为科幻作家,你认为 AI是否可以参与文学创作,能否成为一个具有自我风格的作家,而不仅仅是工具?未来我们要如何重新思考原创性的定义?版权法是否需要被重写来反映这个新生态呢?

陈楸帆Stanley: 作为一个作家,其实我很早就开始与 AI 进行共创。2017年的时候,其实我没有现在市面上能见到的这些好用的写作工具。我跟我原来谷歌中国的同事王咏刚一起搭建了一个非常粗糙的小模型,然后慢慢的由这种写作的实验一步步走到了ChatGPT包括现在的后ChatGPT的状态,等于我们原来看到非常多的写作工具其实现在已经不需要了,因为一个足够强大的大语言模型其实就能够被训练、被定制、被培育成一个很好用的工具,可以完全个性化定制。所以很多以前的创业项目我们能看到慢慢淡出了市场。这也是我感到有意思的:这个发展的速度非常快,大概就是6、7年的时间里我们可以说是完成了一个新的物种进化。

在这过程中,一开始不了解一个工具能做什么,可能会对它的能力有过低或者过高的一个预期,所以你会觉得做不了什么,到后来又觉得非常惊叹的是它超出了预期。在ChatGPT出来的时候,很多人觉得我们的写作可能会被它所替代。但当你跟这个工具更深度地去交互协作之后,你又能更清晰的感知到它的长处跟弱处。它的长板可能是以远超人类的速度去收集资料、去总结,去归纳,但是它的短板可能就是至少目前来说,它没有办法去理解人类的具身的体验,包括情感的、记忆的,很多非常抽象、细腻而且多变的主体性感受,而这一部分我觉得是文学创作里面非常核心的东西。就是作家其实是把自己的意识包括自己的身体作为一个跟外部世界交互的界面,所以如果这个界面它不完备的话,其实只能生产出一些非常平庸主义的、模式化、刻板印象的一些作品。当然目前我跟AI还是有非常多的交互协作,但更多的我会把机器能做好的部分交给它,把更多我觉得人类才能够去承担起来的一些创造性的工作更深度的来逼迫自己(或者像韩炳哲所说的自我剥削),我觉得我需要把自己人类的这部分提升到一定的程度。

现在我们所谓的原创性边界已经非常的模糊,包括所有的这些知识产权的判例、现在正在诉讼的案件(比如纽约时报起诉OpenAI,因为所有的语料都是以高度 tokenize 化的方式被学习、被训练,所以你很难去非常清晰,量化的去定义到底哪部分被借鉴了多少,然后也造成了利益分配非常的不清晰)就所有的这些,我觉得都是需要一个新的对版权法、对著作权的保护等,需要有一个新的框架体系来进行理解和建立。最近好几个网文的平台已经开始用人类作家的写作来训练大模型,把这个作为一个免责条款写在协议里面,引起了很大的争议和反弹。其实这有点像回到工业革命时代的纺织女工,她会被机器取代他们的工作,那么他们到底是拿起锤子去砸烂机器,还是说能够去训练新的技能,找到崭新的职场发展的方向?所以我觉得这些都是在发生中、在进行中的过程。但是我相信在非常近的未来,可能就是三到五年内,整个创意行业(文学、音乐、绘画、影视等等所有涉及到创造力、创意性的工作)的职场生态都会被颠覆。这个颠覆可能在现有逻辑下是一种资本主义式的颠覆,就是以追求效率、追求产出、追求利润最大化作为唯一的逻辑。但是我们对于艺术到底怎样去重新定义它的价值和位置,我觉得都是需要去思考的一个非常重要的问题。

徐思彦: 谢谢。刚才你提到的是作为作家这种特殊的创意性行业的一个变化。那在未来更多的就业场景中,AI 与人类的分工是否会遵循创造力属于人类,重复劳动属于 AI 的规律?如果AI接管了绝大部分重复性的工作,人类又将如何定义有意义的劳动呢?

陈楸帆Stanley: 我觉得这个定义(创造性的工作属于人类,重复性机械性的劳动属于 AI)其实是我们之前的一种假设,是基于人类社会对于工作工种的价值以及难易程度的区分,有一个金字塔型的等级次序。但是这种理解其实不一定适用于 AI时代。因为我们能看到很多的白领、金领的工作其实更容易被 AI 所取代,比如说金融行业、咨询业,然后有一些创造力的部分,包括写歌、作曲、画插画,现在很多公司都会用自己训练或者公开的大模型来替代很多的人类工作者,我们能看到这种相对来说有一定创造力需求但是不追求个性化的大规模复制品级别的创造力很容易被 AI 所取代,而那些所谓的重复性、机械性的蓝领级别的工作反而很难被取代。因为AI的具身智能、成本、对空间的计算能力还不够成熟,还没有被建构出来。最简单的一个,剪头发。我每次来上海都要找我的tony老师,因为很难在别的地方找到能够随我心意的理发师。我们说的做饭、炒菜:现在有一些厨房机器人,但是他们炒出来的菜还是机器人的味道比较重,没有所谓的味觉、嗅觉,所以它很难去判断到底火候怎么样,调料调味是否精准。包括非常简单的比如按摩、建筑工人这样的,一些我们看起来好像非常重复机械的劳动,其实现在还是没有被AI机器人所取代。所以我觉得这个过程会是非常的颠簸复杂,没有办法被简化成创造力属于人类,重复性劳动属于 AI 的二元对立的简化。

但是我们能看到现在很多人都会重新思考工作是为了什么,我为什么要上这个班?包括David Graeber那本《狗屁工作(Bullshit Jobs)》引起很多人的共鸣。我觉得后疫情的AI时代,我们大家都会重新对生命里的很多事情进行一个新的排序。这种排序可能代表着一种价值观的重塑。在未来可能我们慢慢会过渡到一个更加后稀缺的社会。我们以前认为非常重要的一些物质生活的基础条件,包括住房、食物、出行、能源等等,其实成本会不断的下降。那么每个人能够腾出很多的自由时间,不一定需要去做一份朝九晚五的工作来满足这些基础的物质性需求。多出来的这部分自由时间他应该去做什么,就是我们所谓的有意义的劳动到底意味着什么?意义可能是一个非常有弹性、非常高度个人化的领域。每个人所珍视的,认为有意义、有价值的特质可能是不一样的。在这过程中我们能看到,原来所谓单向度的社会(以收入、职场级别,行业影响力、国民生产里的地位来判断一个人的社会身份和所谓的等级),在未来有可能会带来一种新的变化,就是我们的社会等级制度会变得更加多元、流动、有弹性。我们每一个人可能都会构建起自己的一套等级次序。

最后关于创造力是否能够创造出全新的价值。所谓全新的价值可能是在科研领域、艺术领域给我们整个人类的文明级别结构带来一个新的增量,而不是在重复原来的内卷式、消耗型的这种劳动。我希望未来 AI 能够带来的是对人类社会一种重塑,而不是简单的一方压倒另一方,一方替代另一方的二元对立的结构性变化。

徐思彦: 刚才分享的是关于人类在未来如何适应 AI 时代的一些启发。那接下来我们要开脑洞,站在 AI 的视角:如果未来 AI 成为某种形式的叙事者,它对我们理解历史和未来的方式会产生哪些影响?谁书写历史会成为一个新的焦点吗?

陈楸帆Stanley: 这个话题就让我想起腾讯新的总部会有一个科学馆,科学馆里会有一棵科技树回看整个人类科技发展史上重要的时间节点、发明、理论、科学家等等。怎么样把这棵树以某种结构让它变成一个可认知,可理解的一种生长的树?树有树干、有树枝、有树叶,你能看到这种对历史的理解方式,同样是一种以讲故事方式的叙事来让人类能够理解来龙去脉、因果关系。但是我们也会发现科技史里,很多的发现是充满偶然性,充满巧合的,比如说发明电灯、电报等等这样的一些关键节点,其实不是单一的源头,可能同时会有几个科学家做出了类似的发明,但最后因为很多的原因(商业、地缘政治等),最后只有一方被人记住,变成历史的一个关键节点,而其他的那些发明者可能就被淡忘了。我觉得历史是高度以人为中心,被选择讲述的方式、视角、主体都是非常人类中心的。但如果未来 AI 能够成为某种形式的叙事者,它掌握到的信息、数据肯定比历史学家掌握的要大的多。我们知道,历史的叙事会有主体性(比如政权、王朝更迭),同一个社会的不同阶层会有各自的主体性,那么 AI 其实有点像一个全知全能的(我们可以用这个词) “神”。他具备所有的这些主体性共存,甚至超越所有主体性的一个元视角。是否我们能以 AI 去构建起一个元历史叙事的方式,自由的去切换所有的这些视角,在时空里自由地漫游穿梭,然后发现一些我们人类以前都无法发现的所谓因果或者相关性,那么我们对历史的理解可能会有一种全新的形态,我们对于人类历史所有的书写可能都会被颠覆。我们面对的可能是像阿米巴虫一样不断生长变形的一种新的历史叙事形态,所以我觉得非常有意思,它肯定会带来非常多对已有固化的很多观念的冲击,就有可能很多人是无法接受所谓的 AI 视角的历史书写。但是我觉得人类历史其实就是这样不断的自我反思,不断的去确认自己并不是世界中心的这样一种去中心化的趋势,包括从地心说到日心说,从神创论到进化论,到现在我们有了一个新的智能“他者”。这个新的“他者”可能在智能形态方面会远远超出我们人类的个体甚至整体的总和,所以我觉得这一切都是一个巨大的历史叙事的一部分。

当然我觉得很有意思,就是看 AI 会怎么看待它自身的诞生和发展,或者说进化。对于我们所谓的地球行星级别的这种智能,他如何理解他自己的存在本身,它的历史是一个什么位置?所以我觉得这又是一个非常适合开脑洞去写科幻的一个题材。这过程中我会非常希望有很多不同学科的科学家一起来探讨,把科幻的思考框架和方法也带入到我们现实的探讨当中去。

徐思彦: 非常期待 AI 这种新物种带来的新的叙事视角。

徐思彦: 你用过最有趣的 AI 应用是什么?

陈楸帆Stanley: Claude.

徐思彦: 你是否认可大模型的 scaling law已经到达极限?

陈楸帆Stanley: 不认可。

徐思彦: 你希望有一个全能的 AI 助理吗?

陈楸帆Stanley: 希望。

徐思彦: 你认为跟 AI 谈恋爱算出轨吗?

陈楸帆Stanley: 算。

徐思彦: 你希望有永生的数字生命体吗?

陈楸帆Stanley: 希望。

徐思彦: 你觉得未来大模型会产生意识吗?

陈楸帆Stanley: 会。

徐思彦: 未来你愿意和 AI 成为同事吗?

陈楸帆Stanley: 愿意。

徐思彦: 机器人可以给我们养老吗?你希望机器人可以给你干嘛?

陈楸帆Stanley: 可以。我希望他能够帮助我理解“我是谁”。

徐思彦: 大模型的加速发展会带来能源危机吗?

陈楸帆Stanley: 不会。

徐思彦: 你认为大模型实现了数字时代的知识平权还是更加两极分化?

陈楸帆Stanley: 更加两极分化。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...