{文章来源:新智元公众号,文章摘要:一美国律师在诉讼案件中提交了6个根本不存在的案例作为证据,被法庭发现并受到制裁。原因是该律师使用ChatGPT进行法律研究,但ChatGPT编造了虚假案例。事后研究还发现,GPT-4的律师考试成绩被夸大,实际能力有限。文章评价说ChatGPT等人工智能存在理解问题、表达不确定性的困难以及学习错误信息的风险,有待改进。}

=======

{文章总结:文章报道了两件事:1)一美国律师使用ChatGPT进行法律研究,结果ChatGPT编造了6个虚假案例,被法庭发现并受到制裁;2)有研究发现GPT-4的律师考试成绩被夸大,实际水平有限。

案件一再次证明,ChatGPT等人工智能存在以下问题:1)人工智能难以理解人类语言中的细微差别和含义,易产生误解;2)人工智能难以表达自己的不确定性,偏向产生较为肯定的表达;3)人工智能存在学习错

误信息的风险,一旦学习到错误信息,难以自我纠正。所以,尽管ChatGPT表现出色,但不适合处理高风险工作,需要人工介入和监督。

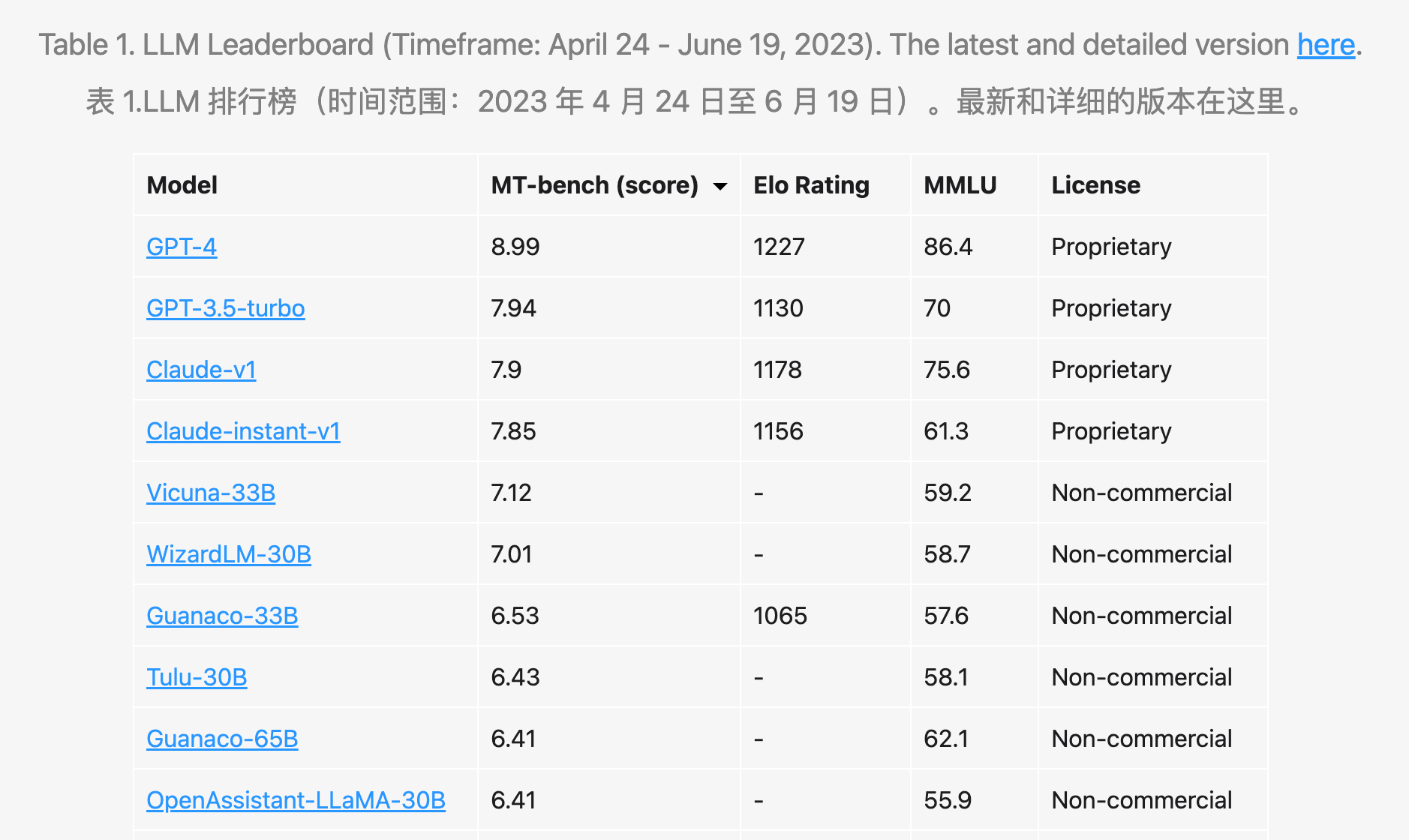

研究二表明,GPT-4的实际水平可能被夸大了。通过检验其在律师考试和知识问答中的表现,研究显示GPT-4的得分在63-68%之间,远未达到90%的水平。这再次说明,尽管人工智能有了较大进步,但仍难以达到人类专家水平,其能力还需进一步提高。

综上,文章提示我们人工智能仍面临理解、表达和学习等方面的困难,其表现难免存在失误和误导,不宜过于依赖。我们需要对人工智能保持警惕,在高风险领域需要人工监督,避免产生不良后果。人工智能还需继续提高,以达到可以更广泛应用于各行各业的水平。}

======

{我的看法:这篇文章报道的两件事再次提醒我们,对人工智能的期望值不宜过高。人工智能虽然取得了长足进步,但仍面临理解、表达和学习等方面的困难,不可能在短期内达到人类的智能水平。

案件一显示,ChatGPT等人工智能在处理高风险工作时表现不佳,易造成严重后果,需要人工监督。研究二也表明,GPT-4的实力被高估,实际水平有限。所以,我们使用人工智能时应保持警惕,不能完全依赖,需要在关键环节有人工介入。

我认为,要发展人工智能,还需在以下几个方面下功夫:1)构建更加广泛和高质量的数据集,提高人工智能的知识广度和深度;2)研究更贴近人类思维的神经网络结构,增强人工智能的理解和推理能力;3)加强对人工智能输出结果的校验与监督,提高其准确性和可靠性;4)探索人工智能学习与纠错的机制,减少学习错误信息的风险。

总之,人工智能还有很长的路要走。它虽然已经开始影响各行各业,但多用于辅助人类,而非完全替代人类。未来,人工智能应向人类智能更广泛和更深入地借鉴与学习,实现人工智能与人类智能的深度融合。但在关键领域,人工智能始终需要人工监督,共同推动社会进步。}

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...